Ouster crea el sensor integrado más avanzado para la conducción autónoma, y funciona con software “open source”

El CEO de Ouster, Angus Pacala, en su artículo “The camera IS the lidar”, ha dado detalles y referencias del OS-1, un sensor que integra tres fuentes de información del entorno y las sincroniza entre sí.

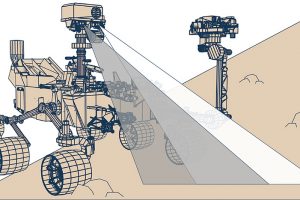

En el camino hacia la conducción autónoma, ha habido importantes avances en el campo de la visión artificial, el reconocimiento de imagen tomada por cámaras ópticas y resuelto por algoritmos de Deep Learning. Y, en general, parece que la investigación ha tenido más peso en este tipo de solución que en la de mejorar o avanzar en el campo de los sensores LIDAR.

La mejora que trae el OS-1 es que presenta un mayor rendimiento gracias a que, en vez de analizar por separado la información de dos entradas diferentes (la cámara óptica y el sensor lidar) y después sincronizarlo, cubre un espectro de radiación mucho más amplio, reproduciendo prácticamente una imagen óptica o similar a la 2D, combinada con la nube de información 3D propia del lidar, con lo que se genera un vector con más parámetros o información útil por pixel que llevarse después al algoritmo de Deep Learning.

La gracia está en que, si, habitualmente, el lidar suele tener problemas con las zonas en las que la geometría es demasiado uniforme y la cámara suele dar información incompleta en zonas mal iluminadas o sin textura, el software actualizado del OS-1 (que además es Open Source), balancea el peso de la computación a la información que va a ser más relevante o que va a aportar mejor predicción.

¿Estamos ante un paso evolutivo importante que nos acerque a la normalización de los vehículos autónomos?

Etiqueta:conduccion autónoma, open source